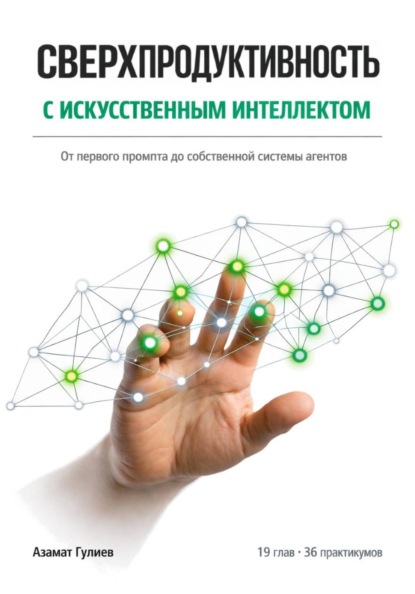

Сверхпродуктивность с искусственым интеллектом: От первого промпта до собственной системы агентов

- -

- 100%

- +

После того как релевантные фрагменты найдены, они включаются в промпт вместе с исходным вопросом. Промпт для языковой модели в RAG-системе содержит три слоя: системная инструкция (роль, правила ответа), найденные фрагменты документов, оригинальный вопрос пользователя.

Системная инструкция задаёт поведение модели при отсутствии ответа в документах. Это критически важно: если нужной информации в найденных фрагментах нет, модель должна сказать «В доступных мне документах ответа на этот вопрос нет» — а не придумать правдоподобный ответ из своих общих знаний. Именно это разграничение делает RAG-систему полезной для работы с корпоративными данными.

Хорошо настроенный системный промпт для корпоративной RAG-системы включает четыре элемента: (1) указание отвечать только на основе предоставленных документов; (2) обязательная ссылка на источник при каждом утверждении; (3) явное признание незнания, если ответа нет в документах; (4) запрет на домысливание, даже если модель «знает» ответ из обучения. Нарушение любого из этих требований превращает RAG-систему в источник правдоподобных, но непроверенных утверждений.

Ссылки на источники — не просто удобство. Они делают ответы проверяемыми. Специалист, получивший ответ «Согласно регламенту управления рисками (раздел 5.3, редакция от 15.01.2025), лимит по сделкам с новыми контрагентами без залога составляет 2 млн рублей», может за 30 секунд открыть этот раздел и убедиться в точности цитаты. Это принципиально другой уровень доверия, чем «ИИ сказал, что лимит 2 миллиона».

6.2.4 Ограничения RAG: когда он не поможетRAG решает конкретную проблему: дать модели доступ к нужным документам в момент ответа. Он не решает другие проблемы — и важно понимать, где именно проходит эта граница.

RAG не помогает, когда нужного документа просто нет в базе. Система может искать только по тому, что в неё загружено. Если политика, регламент или договор не были включены в индекс — система либо честно ответит «не нашла», либо найдёт и предложит что-то похожее, но не то. Неполная база знаний — самая частая причина неудовлетворительной работы RAG-системы в реальных организациях.

RAG не обеспечивает точного понимания сложных числовых таблиц и расчётов внутри документов. Языковая модель, получившая фрагмент с таблицей данных, может ошибаться при арифметических операциях и интерпретации структурированных числовых данных. Для задач, где нужны точные вычисления по табличным данным, RAG — это инструмент нахождения нужного фрагмента, но не инструмент для финансового расчёта.

RAG не заменяет глубокое понимание предметной области. Если найденный документ сам по себе неточен, устарел или противоречив — RAG усилит эту проблему, не устранит её. Система воспроизводит качество базы знаний, а не улучшает его. Если в базе хранятся устаревшие версии регламентов рядом с актуальными — система может вернуть любую из них.

RAG не работает для задач, требующих длинных цепочек рассуждений через несколько документов одновременно. Найти релевантный фрагмент и ответить на основе него — работает. Провести сравнительный анализ пятидесяти договоров, синтезировать выводы, учесть все исключения из всех документов — здесь RAG-поиск должен быть дополнен более сложной логикой обработки.

Распространённая ловушка: система внедрена, специалисты пользуются ей несколько месяцев, а потом выясняется, что часть регламентов в базе — устаревшие версии. Все ответы, данные на основе этих документов, были «правильными» с точки зрения системы, но не соответствовали актуальным требованиям. RAG-система настолько хороша, насколько хороша её база. Управление версиями документов — организационная задача, которую технология не решает сама по себе.

6.3 Практические реализации для пользователя

Понять концепцию RAG и развернуть работающую систему — разные задачи. Хорошая новость 2026 года: для большинства практических сценариев программирование не требуется. No-code инструменты достигли уровня, при котором специалист без технического фона может создать работающего ИИ-ассистента по своей документации за несколько часов.

6.3.1 No-code инструменты для работы с базой документовИнструменты этого класса работают по одной логике: загрузить документы, задать вопрос, получить ответ со ссылкой на источник. Различаются возможностями интеграции, объёмом базы, поддерживаемыми форматами, конфиденциальностью обработки и ценой.

Российский контур: GigaChat API Сбера с инструментами для работы с документами позволяет строить ИИ-ассистентов с обработкой данных в российском облаке — это принципиально для организаций, где передача данных за рубеж ограничена. Яндекс Foundry и YandexGPT с документным поиском предоставляют аналогичные возможности в экосистеме Яндекса. Обе платформы имеют no-code интерфейсы для создания баз знаний без программирования и подходят для работы с данными, к которым применяется 152-ФЗ.

Специализированные платформы для управления знаниями с ИИ-поиском в 2026 году имеют встроенные RAG-возможности поверх базы знаний. Они решают задачу «документы + поиск + ИИ» как единый продукт.

Выбор инструмента определяется не функциональностью, а контекстом: где хранятся данные и кому они принадлежат, есть ли у сервиса сертификация по нужным стандартам безопасности, как решён вопрос с персональными данными, каков реальный объём базы. Самый функциональный сервис, нарушающий политику безопасности организации, не может быть приемлимым вариантом.

6.3.2 ИИ-ассистент по папке файлов: настройка без программированияДля индивидуального использования или небольших команд существует сценарий «подключить папку документов и задавать вопросы» — без корпоративного развёртывания, без технической команды, за время от получаса до нескольких часов.

Наиболее доступный путь в 2026 году: специализированные no-code платформы типа Poe (через корпоративный аккаунт), ChatPDF для работы с отдельными PDF, локальные решения на базе LM Studio или Ollama с подключаемыми плагинами для работы с документами. Для пользователей с базовыми техническими навыками — Dify или AnythingLLM, которые устанавливаются локально и обеспечивают полный контроль над данными.

Рабочий процесс без программирования на примере AnythingLLM (локальная установка): скачать и установить приложение (работает как обычный десктоп), создать «рабочее пространство», загрузить документы (PDF, DOCX, TXT, MD), дождаться индексации (несколько минут для небольшой базы), начать задавать вопросы. Модель работает локально — данные не покидают компьютер. Подходит для документов под NDA или с персональными данными.

Три параметра, которые стоит настроить при первоначальной конфигурации. Первый — размер чанка: для нормативных документов оптимально 300–500 слов, для технических инструкций — 200–300, для деловой переписки — одно письмо как единица. Второй — количество извлекаемых фрагментов (top-k): значение 4–6 обычно даёт достаточно контекста без перегрузки. Третий — формат ссылок на источники: задайте в системном промпте явное требование указывать название документа и раздел при каждом факте.

Ограничение локальных решений — требования к ресурсам компьютера. Для приемлемого качества ответов нужна достаточная оперативная память (16–32 ГБ) и желательно производительная видеокарта. Облачные решения работают на любом устройстве с браузером, но требуют передачи данных на серверы сервиса.

6.3.3 Корпоративные базы знаний и их RAG-интеграцииКорпоративная RAG-система — это не просто «папка документов с поиском». Это система с управлением жизненным циклом документов, разграничением доступа, аудитом запросов, интеграцией с корпоративными инструментами и процедурами обновления базы. Разница между персональным ассистентом и корпоративной системой — это разница между записной книжкой и ERP-системой.

Разграничение доступа — первое требование. Не все сотрудники должны видеть все документы. HR-директор может спрашивать про зарплатные вилки — рядовой сотрудник не должен получать эти данные из той же системы. Это требует интеграции с Active Directory или корпоративной системой управления правами. Хорошая RAG-платформа поддерживает фильтрацию результатов по правам доступа пользователя — плохая возвращает всё из базы без учёта ограничений.

Управление версиями документов — второе требование. Если в базе есть несколько версий одного регламента, система должна знать, какая актуальная, и отвечать на основе именно неё. Это не техническая задача RAG-системы по умолчанию — это организационная задача: назначить ответственных за обновление базы, определить процедуру замены устаревших версий, настроить метаданные документов (версия, дата, статус: действующий / отменён / в редакции). Без этой процедуры база быстро становится неуправляемой.

Аудит и логирование запросов — третье требование. В корпоративном контексте важно понимать, какие вопросы задавались системе и какие ответы давались. Это нужно для контроля качества, выявления пробелов в базе знаний, аудита при расследовании инцидентов. Хорошие корпоративные RAG-платформы имеют встроенный аудит; при самостоятельном развёртывании это нужно предусмотреть отдельно.

Интеграция с рабочими процессами определяет, насколько система используется в реальной работе. RAG-система, изолированная от рабочих инструментов, не даёт полной ценности. Максимум — когда она встроена в интерфейс, где сотрудник и так работает: в корпоративный мессенджер, в систему управления задачами, в почту. Тогда вопрос возникает и задаётся там, где возникает потребность — без переключения контекста.

Экономика внедрения для небольших компаний: корпоративное развёртывание RAG при использовании no-code платформ обходится значительно дешевле, чем кажется. Типичная конфигурация для компании 50–200 человек — cloud-решение на российской платформе с базой 1 000–5 000 документов и 50–200 запросами в день — по оценкам практиков, укладывается в 30 000–80 000 рублей в месяц включая стоимость модели, хранения и интерфейса. Альтернативная стоимость — часы специалистов, потраченные на поиск информации в документах.

6.3.4 Личная база знаний с ИИ-поискомПерсональная база знаний с ИИ-поиском — инструмент, который индивидуально ценен для специалиста, работающего с большим объёмом материалов: исследователя, консультанта, юриста, аналитика, преподавателя. Идея: накапливать заметки, статьи, документы и иметь возможность быстро находить нужное через естественный язык, а не через теги и папки.

Obsidian с плагинами Copilot или Smart Connections — наиболее распространённое решение для исследователей и специалистов. База заметок в Markdown-формате, семантический поиск поверх неё, возможность задавать вопросы через встроенный интерфейс. Данные хранятся локально. Качество поиска зависит от качества заметок — система не улучшает то, что написано плохо.

Notion AI в личном плане — более доступный вариант для тех, кто уже пользуется Notion. Вопросы по базе, суммаризация, поиск по содержанию — без настройки, работает из коробки. Данные в облаке Notion; при работе с чувствительными материалами — фактор, который нужно учитывать.

Ценность личной базы знаний формируется медленно. Первые три месяца — ощущение «я пишу в пустоту». Через полгода активного пополнения система начинает экономить значимое время: «я точно это читал, но где?» превращается в запрос к ассистенту с ответом за 15 секунд. Это не немедленный эффект — это инвестиция с накопительным возвратом.

Практикум 6.А: Создание ИИ-ассистента по папке документов

Задача: за один сеанс работы создать работающего ИИ-ассистента по набору реальных рабочих документов и провести тест качества ответов.

Что делать:

1. Выберите инструмент по своей ситуации: если данные конфиденциальны — AnythingLLM (локальная установка, бесплатно); если данные публичные или внутренние без ограничений — Notion AI или GigaChat с функцией документного поиска.

2. Подготовьте набор из 15–25 реальных рабочих документов одной тематики: регламенты, FAQ, процедуры, шаблоны договоров, приказы. Форматы: PDF, DOCX, TXT — что есть.

3. Создайте новое рабочее пространство в инструменте, загрузите документы, дождитесь завершения индексации.

4. Составьте тестовый список из 10 вопросов трёх типов: (а) прямой фактический вопрос, ответ на который точно есть в документах; (б) косвенный вопрос, требующий синтеза из нескольких документов; (в) вопрос, ответа на который в документах нет.

5. Задайте все 10 вопросов. Для каждого ответа: проверьте ссылку на источник, откройте исходный документ и убедитесь в точности. Зафиксируйте: сколько ответов точны со ссылкой; сколько содержат ошибки; как система повела себя при отсутствующей информации — честно отказала или галлюцинировала.

Ожидаемый результат: работающий ИИ-ассистент с базой из 15–25 документов. Точность по прямым вопросам ≥ 80%, понимание отсутствующей информации — честный отказ хотя бы в 2 из 3 случаев типа (в).

На что обратить внимание: если система уверенно отвечает на вопрос (в), которого в документах нет — переработать системный промпт с более жёстким требованием «отвечай только на основе документов». Если ссылки неточные или отсутствуют — добавить в системный промпт: «При каждом утверждении указывай название документа и раздел».

6.4 Суммаризация и синтез документов

RAG даёт доступ к информации в документах через вопросно-ответный интерфейс. Но работа с документами не сводится только к поиску конкретного факта — она включает понимание целого документа, сравнение нескольких версий, выявление противоречий и слабых мест. Эти задачи требуют другого подхода: не «найди фрагмент», а «обработай документ целиком или несколько документов вместе».

6.4.1 Суммаризация длинных документовСуммаризация — самая часто используемая операция с документами. Но «суммаризируй этот документ» как промпт даёт посредственные результаты, потому что не задаёт цель и аудиторию. Результат суммаризации, полезный для юриста, принципиально отличается от результата, полезного для генерального директора, который за пять минут до встречи хочет понять суть.

Структура эффективного промпта для суммаризации содержит три компонента: кто будет читать результат и зачем; какой формат нужен (тезисы, нарративный текст, таблица, executive summary); что именно нужно выделить — ключевые выводы, риски, обязательства, сроки, числа.

Промпт для суммаризации технического регламента для руководителя: «Суммаризируй этот регламент для генерального директора, который должен принять решение о его утверждении. Формат: executive summary на одну страницу. Структура: (1) что меняется относительно предыдущей версии; (2) ключевые требования, влияющие на бизнес-процессы; (3) требования к бюджету или ресурсам, если есть; (4) риски неисполнения. Числа и сроки — явно.»

Тот же документ для юриста, проверяющего соответствие 152-ФЗ: «Проверь этот регламент на соответствие требованиям 152-ФЗ. Для каждого раздела, где упоминается обработка персональных данных: цитата из регламента, соответствующая норма 152-ФЗ, оценка — соответствует / требует уточнения / противоречит. Если регламент содержит пробелы в части ПДн — укажи явно.»

Для длинных документов (50+ страниц) стратегия суммаризации зависит от инструмента. Модели с длинным контекстом принимают большие документы целиком — это наилучший вариант при наличии доступа. При ограниченном контексте — иерархическая суммаризация: сначала суммаризировать каждый раздел по отдельности, затем суммаризировать полученные резюме. Качество хуже, чем при работе с полным текстом, но приемлемо для большинства задач.

Принципиальная ошибка: просить «кратко» без указания формата и аудитории. «Кратко» — это 200 слов или 2000? Тезисы или нарратив? С числами или без? Без ответа на эти вопросы модель выберет по умолчанию — и этот выбор может не совпасть с тем, что нужно.

6.4.2 Извлечение ключевых тезисов и структурыИзвлечение (extraction) — операция, при которой из документа берётся конкретная категория информации, а остальное игнорируется. Это точнее, чем суммаризация: суммаризация создаёт сжатое изложение всего; извлечение достаёт только нужное.

Сценарии извлечения с измеримой экономией времени. Извлечение реквизитов из договора: наименования сторон, дата, срок, стоимость, порядок оплаты, ответственность, условия расторжения — за 30 секунд вместо 10–15 минут чтения. Извлечение задач и ответственных из протокола: «Перечисли все задачи из этого протокола. Для каждой: формулировка, ответственный, срок. Если ответственный или срок не указан — отметь явно.» Извлечение технических требований из ТЗ: «Перечисли все функциональные требования из этого технического задания. Нумерацию сохрани из оригинала.»

Для юридических документов извлечение особенно ценно, когда нужно сравнивать несколько договоров по единому набору параметров. Промпт для каждого договора одинаковый; результаты — таблица сравнения. Это аналитика, которую раньше делал юрист вручную часами.

Извлечение структуры — особый вид операции для документов, у которых структура не очевидна из форматирования. Например, длинный нарративный документ без заголовков: «Определи логические разделы этого документа. Для каждого раздела: предполагаемое название, краткое описание содержания (1–2 предложения), диапазон страниц.» Результат — карта документа, с которой потом проще задавать прицельные вопросы.

6.4.3 Сравнение нескольких документовСравнительный анализ нескольких документов — задача, где языковые модели с длинным контекстом дают наибольший прирост продуктивности. Сравнить пять версий договора по двадцати параметрам вручную — несколько часов работы юриста или специализированный инструмент. С языковой моделью — 15–30 минут при правильном промпте.

Принцип работы: все сравниваемые документы подаются в контекст одновременно (или последовательно при ограниченном контексте), задача формулируется как сравнение по конкретным критериям. Модель находит структурные и содержательные различия между документами при правильно сформулированном запросе.

Промпт для сравнения трёх версий регламента: «Перед тобой три версии регламента управления инцидентами: V1 (2022), V2 (2023), V3 (2025). Для каждого из следующих аспектов опиши, что изменилось от версии к версии: (1) ответственные роли; (2) сроки реагирования; (3) эскалация; (4) отчётность. Если аспект не изменился — укажи это явно. Если в какой-то версии аспект отсутствует — укажи отсутствие.»

Для сравнения договоров с разными контрагентами по стандартному набору параметров эффективен формат «таблица-чек-лист»: «Сравни три договора поставки и заполни таблицу: строки — критерии (срок, стоимость, условия оплаты, ответственность за нарушение сроков, порядок расторжения, форс-мажор); столбцы — Договор А, Договор Б, Договор В. В каждой ячейке — краткое содержание соответствующего условия или "не указано".»

Ограничение: при очень большом количестве длинных документов (20+ договоров по 30 страниц) одновременная обработка требует модели с контекстным окном на несколько миллионов токенов. Альтернатива — двухэтапный процесс: сначала провести извлечение реквизитов из каждого документа по отдельности, затем сравнивать уже извлечённые структурированные данные. Двухэтапный процесс надёжнее в этом сценарии.

6.4.4 Поиск противоречий и слабых местКритический анализ документа — задача, где языковая модель может сыграть роль рецензента, который не устаёт и не пропускает детали из-за знакомости текста. Когда документ писали одни и те же люди месяцами, они часто не замечают внутренних противоречий, неясных формулировок и пробелов — «замыленный глаз». Модель читает текст «свежо» каждый раз.

Для регламентов и процедур: «Найди в этом регламенте пункты, которые: (1) противоречат друг другу; (2) не определяют ответственного за выполнение; (3) не устанавливают срок или критерий завершения; (4) допускают неоднозначную интерпретацию. Для каждого найденного пункта: цитата, тип проблемы, краткое описание.»

Для договоров: «Проверь этот договор с позиции стороны А. Найди пункты, которые: (1) создают непропорциональную ответственность для стороны А; (2) дают стороне Б одностороннее право изменить условия; (3) содержат размытые формулировки, которые можно трактовать в пользу стороны Б при споре; (4) противоречат законодательству РФ — укажи, какому именно.»

Для технических заданий: «Проверь это техническое задание на полноту. Какие требования сформулированы так, что их невозможно проверить (нет измеримого критерия)? Какие термины используются без определения? Есть ли противоречия между требованиями?»

Важная оговорка: модель может пропустить некоторые противоречия, особенно если они неявные — например, когда несоответствие возникает только в комбинации с нормой законодательства, которой нет в переданном документе. Результат критического анализа — список гипотез для проверки, а не финальный аудиторский отчёт. Специалист проверяет найденные места и принимает решение.

Пример: методист образовательной программы использует модель для рецензирования учебных программ курсов перед утверждением. Промпт: «Проверь эту программу курса. Найди: (1) учебные результаты, которые не поддерживаются содержанием; (2) темы без явного LO; (3) оценочные задания, не соответствующие среднему уровню заявленных критериев обучения; (4) пробелы в логике — где порядок тем нарушает принцип от простого к сложному.» До внедрения: каждая программа рецензировалась 3–4 дня. После: первичный список замечаний — 15 минут, финальная рецензия методиста — 1–2 часа. Общее время сократилось в 3–4 раза.

Практикум 6.Б: Сравнение версий документа с извлечением ключевых расхождений

Задача: провести сравнительный анализ двух версий одного документа и получить структурированный отчёт об изменениях.

Что делать:

1. Найдите два документа, которые представляют разные версии одного и того же: два варианта договора с одним контрагентом, два издания внутреннего регламента, черновик и финальная версия технического задания. Если реальных нет — два похожих публичных документа (уставы схожих организаций, положения об одном органе из разных регионов).

2. Составьте список из 6–8 критериев сравнения, важных для вашей предметной области. Примеры для договора: стороны, срок действия, стоимость, порядок оплаты, ответственность за нарушение, расторжение, форс-мажор, подсудность.

3. Сформулируйте промпт: «Ниже два документа. Сравни их по следующим критериям: [список критериев]. Для каждого критерия: что в документе 1, что в документе 2, есть ли значимое расхождение (да/нет). Если критерий отсутствует в одном из документов — укажи явно. Выдай результат таблицей.»

4. Загрузите оба документа и задайте промпт.

5. Проверьте 3–4 ячейки таблицы по первоисточнику: откройте соответствующее место в документе и убедитесь, что модель воспроизвела содержание корректно.

Ожидаемый результат: сравнительная таблица по всем критериям. Время выполнения: 15–25 минут включая выбор документов и проверку.

На что обратить внимание: проверьте, не «придумала» ли модель содержание для критерия, которого в документах нет, вместо «не указано». Для очень длинных документов (30+ страниц каждый) — проверьте, не потеряла ли модель фрагменты из середины: у некоторых моделей есть феномен «потери середины», когда контент из центра длинного текста извлекается хуже, чем начало и конец.

Типичные ошибки1. База знаний без управления версиями

В чём состоит: в базу загружены документы, но никто не следит за обновлениями. Через полгода в базе лежат актуальная версия регламента и три устаревшие рядом. Система отвечает на основе любой из них — и пользователь не знает, какую версию она использовала.

✓ Как правильно: назначить ответственного за обновление базы. При каждом обновлении документа — удалить старую версию из базы, загрузить новую с чёткими метаданными (дата, версия, статус). Лучше маленькая, но актуальная база, чем большая с устаревшим контентом.

2. «Суммаризируй это» без указания аудитории и формата

В чём состоит: промпт без контекста даёт обобщённый результат, который не подходит никому конкретно. Модель выбирает формат и уровень детали самостоятельно — и это часто не то, что нужно.

✓ Как правильно: всегда задавать три параметра — кто читатель, какой формат нужен (тезисы, нарратив, executive summary, таблица), что именно нужно выделить. Промпт в три строки даёт результат в три раза лучше.

3. Доверие ответу без проверки ссылки на источник